Principais destaques

- Projetos de código aberto começam a restringir ou proibir contribuições feitas por inteligência artificial

- Mantenedores relatam aumento de retrabalho, baixa qualidade e esgotamento das equipes

- Plataformas como o GitHub estudam medidas para conter a avalanche de pull requests automatizados

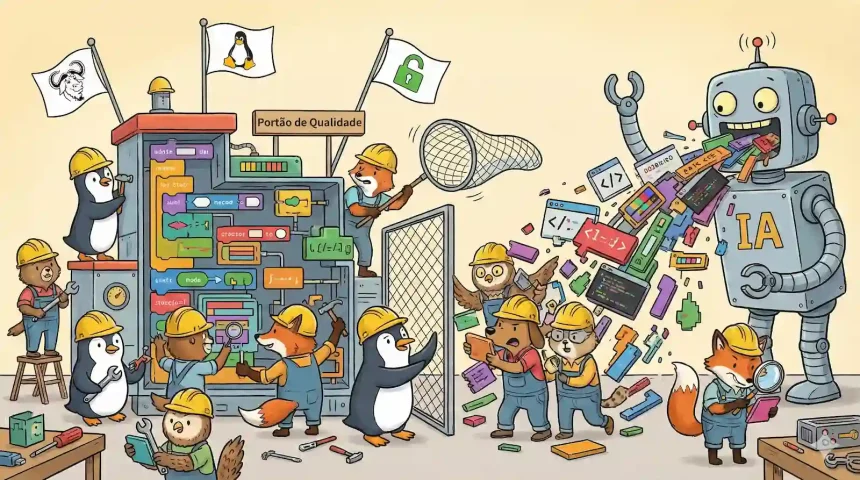

O avanço das ferramentas de inteligência artificial está provocando uma reação inesperada no universo do software livre.

Projetos tradicionais de código aberto passaram a impor barreiras ao envio de trechos criados por modelos de linguagem, alegando que a enxurrada de contribuições automáticas está comprometendo a qualidade e a sustentabilidade do trabalho colaborativo.

A discussão ganhou força nas últimas semanas, após diferentes comunidades anunciarem novas políticas internas para lidar com o problema.

Widelands decide rejeitar código criado por IA

No dia 20 de fevereiro, os desenvolvedores do Widelands comunicaram que passarão a recusar qualquer contribuição gerada por inteligência artificial.

O jogo, inspirado em The Settlers II e mantido por voluntários, afirmou que esse tipo de conteúdo costuma apresentar problemas éticos e legais, especialmente relacionados a direitos autorais de dados usados no treinamento dos modelos.

Além das questões jurídicas, a equipe destacou que muitos envios são genéricos, pouco alinhados às necessidades específicas do projeto e exigem tempo extra de revisão. Para um grupo que já opera com recursos limitados, esse esforço adicional tem se tornado insustentável.

EFF estabelece regras mais rígidas para uso de LLMs

A Electronic Frontier Foundation também anunciou uma política mais clara sobre o uso de grandes modelos de linguagem em seus projetos de código aberto, como Certbot e Privacy Badger.

A entidade não proibiu totalmente o uso de IA, mas passou a exigir que quem submeter código demonstre entendimento completo do que está enviando. Documentação e comentários, segundo a nova regra, devem ser redigidos por humanos.

De acordo com integrantes da organização, muitos trechos gerados por IA apresentam falhas conceituais, exageros técnicos ou até informações inventadas. Em equipes pequenas, revisar esse material tem sido descrito como uma tarefa desgastante e demoralizante.

Crise se espalha por projetos populares

O problema não se limita a poucos casos isolados. No projeto do motor gráfico Godot, mantenedores relataram aumento expressivo de pull requests criados por IA que “muitas vezes não fazem sentido”. A frustração tem sido pública, com desenvolvedores questionando por quanto tempo conseguirão lidar com o volume crescente.

O tradicional projeto curl decidiu encerrar seu programa de recompensas por bugs após perceber que uma parcela relevante dos relatórios recebidos era produzida por IA, sem revelar vulnerabilidades reais quando analisados isoladamente.

Já o GitHub reconheceu que o fenômeno está em seu radar. A plataforma estuda oferecer ferramentas para que mantenedores limitem ou até desativem o envio de pull requests externos, numa tentativa de conter o que alguns compararam a um novo “Setembro Eterno”, expressão usada para descrever momentos de ruptura cultural na internet.

No centro da crise está uma assimetria clara: gerar código com IA tornou-se rápido e quase gratuito. Revisar, testar e validar cada linha continua sendo um processo humano, demorado e criterioso. Para mantenedores voluntários, a conta simplesmente não fecha.