Principais destaques

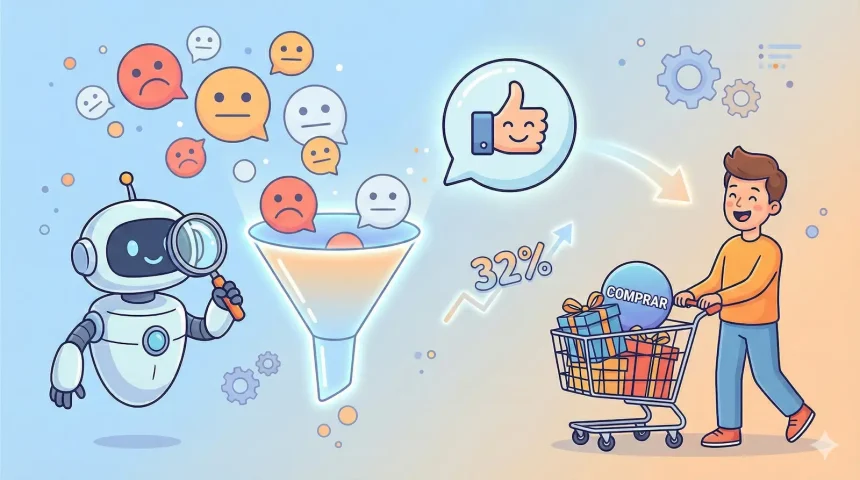

- Consumidores têm 32% mais chance de comprar após ler resumos feitos por IA

- Modelos de linguagem alteraram o tom original das avaliações em 26,5% dos casos

- Pesquisadores alertam para riscos de viés e alucinações em decisões de alto impacto

Um novo estudo conduzido por cientistas da computação da Universidade da Califórnia em San Diego acendeu um alerta importante para quem acompanha o avanço da inteligência artificial no consumo digital.

Segundo a pesquisa, consumidores demonstraram 32% mais probabilidade de comprar um produto depois de ler um resumo de avaliação gerado por chatbot, em comparação com a leitura do texto original escrito por uma pessoa.

O trabalho foi apresentado na Conferência Internacional Conjunta sobre Processamento de Linguagem Natural e no encontro do Capítulo Ásia-Pacífico da Associação de Linguística Computacional em dezembro de 2025. Os autores afirmam que este é o primeiro estudo a trazer evidências quantitativas de que vieses cognitivos introduzidos por grandes modelos de linguagem influenciam decisões reais dos usuários.

Como os resumos alteram a percepção do consumidor

Ao analisar avaliações resumidas por modelos de linguagem, os pesquisadores descobriram que 26,5% delas tiveram o sentimento modificado em relação ao texto original. Em muitos casos, o resumo apresentava um tom mais positivo do que a avaliação humana, criando uma percepção mais favorável do produto.

Para medir o impacto direto nas decisões de compra, 70 participantes foram divididos entre dois grupos. Um leu avaliações originais de itens como fones de ouvido, lanternas de cabeça e rádios portáteis. O outro grupo leu apenas versões resumidas por IA. O resultado impressiona: 84% dos leitores dos resumos afirmaram que comprariam o produto, contra 52% entre aqueles que tiveram acesso ao texto original.

O dado mostra que a forma como a informação é sintetizada pode influenciar significativamente o comportamento do consumidor.

O problema das alucinações e da precisão

Outro ponto crítico identificado no estudo foi a chamada alucinação dos modelos de linguagem. Ao serem testados com perguntas baseadas em notícias verificáveis, os sistemas erraram ou inventaram informações em 60% das respostas quando o conteúdo estava fora de seus dados de treinamento.

Segundo os pesquisadores, essa limitação revela uma dificuldade persistente das IAs em diferenciar fatos de informações fabricadas. Em contextos de baixo risco, como compras online, o impacto já se mostrou relevante. Em cenários mais sensíveis, como finanças, saúde ou políticas públicas, as consequências podem ser ainda mais graves.

Não há solução simples para o viés

A equipe avaliou seis modelos de linguagem diferentes e testou 18 estratégias para reduzir vieses e alucinações. Embora algumas técnicas tenham apresentado melhorias pontuais, nenhuma foi eficaz de forma ampla. Em alguns casos, as tentativas de correção acabaram tornando os modelos menos confiáveis em outras tarefas.

Os autores destacam que combater viés de maneira genérica é diferente de ajustar sistemas para contextos específicos. Isso indica que a personalização e o controle de aplicação podem ser caminhos mais promissores do que soluções universais.

Impactos além do comércio eletrônico

Embora o experimento tenha focado em decisões de compra, os pesquisadores alertam que o fenômeno pode se estender a áreas como mídia, educação e formulação de políticas públicas. Parte do viés parece surgir porque os modelos dão mais peso às primeiras informações do texto original, deixando de lado nuances importantes que aparecem depois.

O estudo reforça uma questão central para quem acompanha a evolução da inteligência artificial: conveniência e eficiência não eliminam a necessidade de senso crítico. À medida que os chatbots se tornam intermediários entre pessoas e informação, compreender seus limites se torna essencial.