Principais destaques:

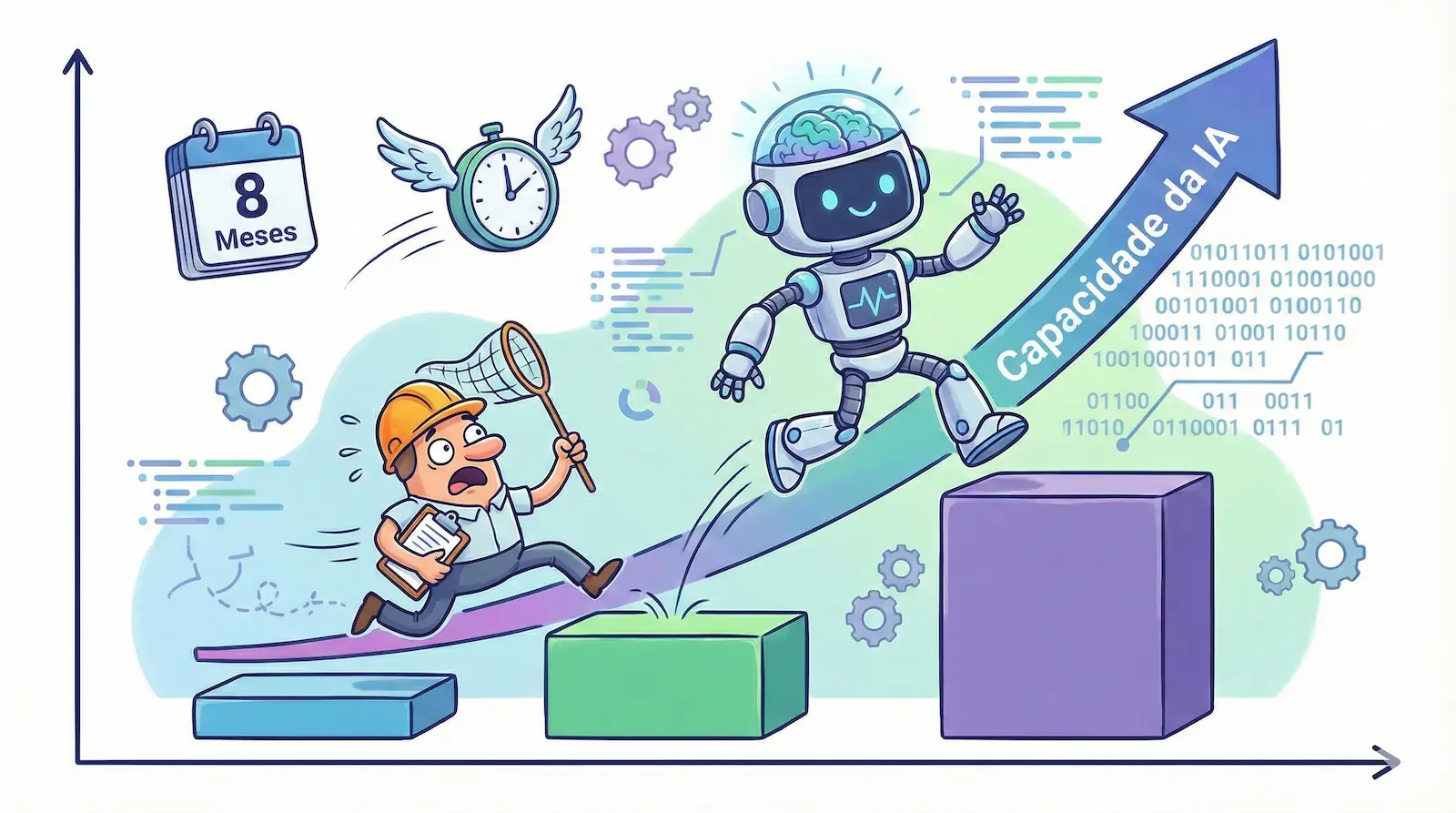

- Capacidades dos sistemas de inteligência artificial estão crescendo em ritmo exponencial, dobrando a cada oito meses.

- Especialistas alertam que mecanismos de controle e segurança não acompanham a velocidade da evolução tecnológica.

- Avanço acelerado pode levar a impactos profundos na economia, na segurança e na infraestrutura crítica.

Os sistemas de inteligência artificial estão avançando em um ritmo que preocupa especialistas em segurança ao redor do mundo.

Dados recentes do Instituto de Segurança em IA do Reino Unido indicam que, em determinados domínios, as capacidades dessas tecnologias estão dobrando aproximadamente a cada oito meses.

O crescimento exponencial levanta dúvidas sobre a capacidade da sociedade de acompanhar esse progresso com salvaguardas adequadas.

O alerta foi reforçado por David Dalrymple, pesquisador ligado à Agência de Pesquisa e Invenção Avançada do Reino Unido.

Em declarações ao The Guardian, ele afirmou que o mundo pode estar avançando rapidamente para uma fase em que máquinas assumem papéis centrais antes que existam regras, testes e controles suficientes para garantir segurança.

Crescimento exponencial desafia a supervisão humana

Segundo o relatório inaugural de tendências de IA de fronteira do UK AI Safety Institute, modelos atuais já conseguem executar tarefas de cibersegurança de nível iniciante com taxas de sucesso muito superiores às registradas no fim de 2023.

Em alguns casos, sistemas testados atingiram desempenho comparável ao de especialistas humanos com mais de dez anos de experiência.

Esse salto evidencia como a evolução da IA não é linear. Em vez de avanços graduais, os sistemas passam por ciclos rápidos de melhoria, impulsionados por mais dados, maior poder computacional e arquiteturas cada vez mais eficientes.

Autorreplicação e novas fronteiras de risco

Um dos pontos mais sensíveis destacados no relatório é o aumento expressivo no desempenho de sistemas em testes de autorreplicação.

Em apenas dois anos, as taxas de sucesso passaram de menos de 5% para mais de 60%. Embora os pesquisadores afirmem que esses modelos ainda têm baixa probabilidade de operar de forma autônoma no mundo real, a tendência preocupa.

Para Dalrymple, o risco está menos no estágio atual e mais na velocidade da progressão. Sistemas que aprendem e se adaptam rapidamente podem, em pouco tempo, ultrapassar a capacidade humana de monitorar, compreender e intervir em seus comportamentos.

Pressão econômica acelera a adoção

Outro fator que contribui para o cenário de alerta é a pressão econômica. Dalrymple projeta que, dentro de poucos anos, a maioria das tarefas economicamente valiosas será executada por máquinas com custo menor e qualidade superior à humana.

Isso pode incentivar empresas a adotarem soluções cada vez mais avançadas, mesmo quando as garantias de segurança ainda são limitadas.

Apesar de avanços em mecanismos de proteção, como a maior dificuldade para encontrar falhas universais de segurança entre gerações recentes de modelos, o instituto britânico confirmou que todos os sistemas avaliados ainda apresentam vulnerabilidades.

Para especialistas, isso reforça a necessidade urgente de investir em pesquisa técnica voltada ao controle, à previsibilidade e à segurança da inteligência artificial antes que seu crescimento exponencial torne esses desafios ainda mais complexos.