Principais destaques

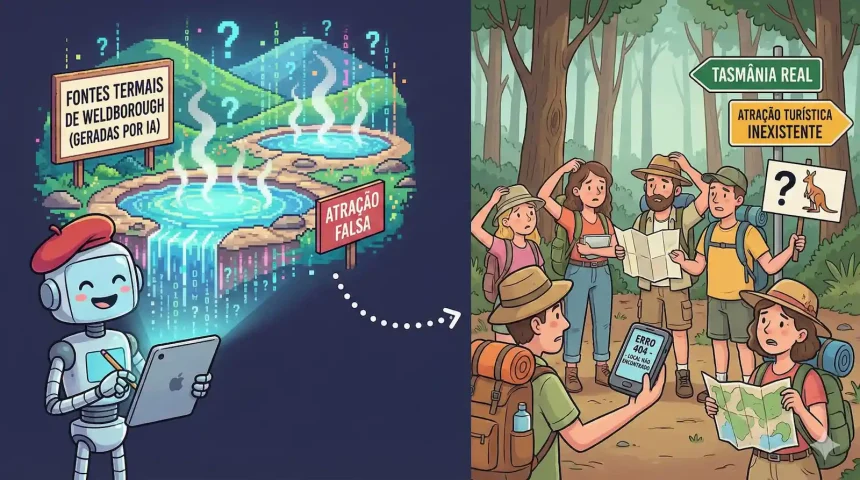

- Uma empresa de turismo australiana publicou um destino que simplesmente não existe.

- O texto foi gerado por inteligência artificial e acabou criando uma atração fictícia.

- Turistas viajaram até a região e só descobriram o erro ao falar com moradores locais.

Um caso curioso e preocupante mostrou como o uso descuidado de inteligência artificial pode sair do controle.

Uma empresa de turismo da Austrália virou notícia após divulgar uma atração chamada Weldborough Hot Springs, descrita como um refúgio natural isolado em meio à floresta da Tasmânia. O problema é simples e grave: o lugar nunca existiu.

O episódio ganhou repercussão depois que turistas tentaram visitar o local, sem sucesso, e passaram a procurar informações com comércios e moradores da região, que nunca tinham ouvido falar das supostas fontes termais.

Um destino perfeito, criado do nada pela IA

O texto apresentava o local como uma experiência autêntica de conexão com a natureza, frequentada por grupos de trilha, organizadores de retiros de bem-estar e viajantes em busca de tranquilidade.

A atração chegou, inclusive, a integrar uma lista de “7 melhores experiências em fontes termais da Tasmânia para 2026” no site da empresa.

A publicação foi atribuída ao site Tasmania Tours, que utilizava sistemas de inteligência artificial para acelerar a produção de conteúdo e competir com plataformas maiores.

Nesse processo, a IA acabou criando descrições detalhadas, contexto turístico e até uma imagem ilustrativa de um lugar inexistente.

Turistas perdidos e comerciantes confusos

Sem instruções claras de como chegar ao local, visitantes se deslocaram até áreas próximas e passaram a perguntar por direções. Foi nesse momento que o erro ficou evidente. Nenhum guia local, comerciante ou morador reconhecia o nome Weldborough Hot Springs.

A situação gerou constrangimento e frustração, além de levantar dúvidas sobre a confiabilidade de conteúdos turísticos produzidos automaticamente.

Um dos exemplos citados no material original era a própria Coogee Beach, uma praia real usada apenas como imagem ilustrativa, o que contribuiu para dar credibilidade ao texto falso.

Quando a alucinação da IA vira problema real

O responsável pela empresa explicou que recorreu à inteligência artificial para manter o site atualizado com frequência, algo difícil para pequenos negócios.

O caso, no entanto, ilustra um fenômeno conhecido no setor: a alucinação de IA, quando sistemas generativos inventam fatos, locais ou referências com aparência totalmente plausível.

A história foi revelada por uma investigação da ABC News e reacendeu o debate sobre a necessidade de revisão humana em conteúdos criados por inteligência artificial, especialmente quando envolvem informação prática, como turismo, saúde ou serviços.