Principais destaques:

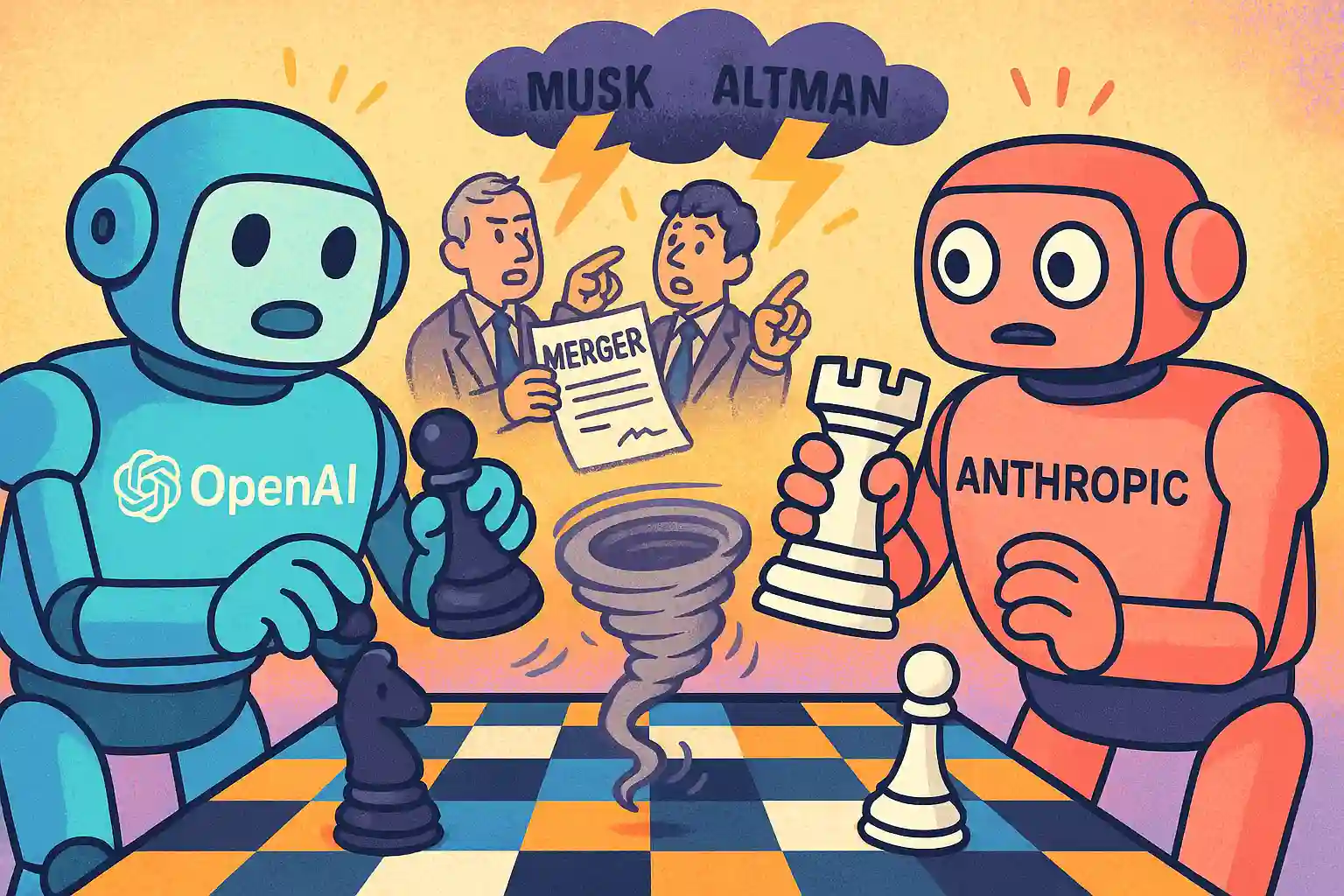

- Depoimento de Ilya Sutskever revela que OpenAI e Anthropic chegaram a discutir uma fusão em 2023.

- Conversas ocorreram logo após a polêmica demissão de Sam Altman, em meio ao caos interno na empresa.

- O episódio reacende o conflito entre Elon Musk e Altman e expõe novas fissuras no ecossistema de IA.

Quando tudo quase mudou na IA

Um depoimento recente de Ilya Sutskever, o ex-cientista-chefe e cofundador da OpenAI, mexeu com o coração da comunidade de inteligência artificial.

Em uma audiência relacionada ao processo movido por Elon Musk contra a OpenAI, Sutskever revelou que o conselho da empresa considerou uma fusão com ninguém menos que a Anthropic, sua principal concorrente, apenas 24 horas após a demissão de Sam Altman, em novembro de 2023.

Segundo Sutskever, a proposta partiu de uma conversa entre a conselheira Helen Toner e a liderança da Anthropic, Dario e Daniela Amodei, e incluía a ideia de unir as duas companhias sob o comando da equipe da Anthropic.

Em seus próprios termos, Sutskever declarou estar “muito insatisfeito com a ideia”, deixando claro que a proposta quase alterou de forma irreversível o futuro da OpenAI e de toda a indústria de IA.

Uma fusão improvável que nasceu do caos

A revelação resgata um dos períodos mais turbulentos da história recente da tecnologia. No dia 17 de novembro de 2023, o conselho da OpenAI anunciava a saída repentina de Altman, alegando “perda de confiança”.

O choque foi imediato: executivos atordoados, empregados ameaçando deixar a empresa, e gigantes como a Microsoft observando a crise com apreensão.

Foi nesse vácuo de liderança que a discussão com a Anthropic emergiu — um movimento quase impensável, considerando que a Anthropic nasceu em 2021 justamente como cisão da OpenAI, quando um grupo de ex-pesquisadores (entre eles, os irmãos Amodei) deixou a empresa por divergências sobre segurança e ética em IA.

A ideia não prosperou. Obstáculos práticos, segundo o depoimento, impediram que a proposta fosse adiante.

E a pressão dos funcionários, mais de 700 dos 770 assinaram uma carta ameaçando se demitir, levou à rápida reviravolta: Sam Altman foi reintegrado ao cargo de CEO em 22 de novembro. A tempestade passava, mas as rachaduras ficariam visíveis por muito tempo.

Musk, Altman e o novo capítulo da guerra pela ética na IA

O caso veio à tona dentro de um processo movido por Elon Musk, que acusa a OpenAI de ter “traído sua missão original sem fins lucrativos”.

Em mais de dez horas de testemunho, Sutskever também mencionou um memorando de 52 páginas detalhando o que ele chamou de “padrão de manipulação” na condução de Altman — material que reacendeu a guerra fria entre os dois gigantes da tecnologia.

As respostas não tardaram: Musk publicou nas redes sociais que Altman “roubou uma organização sem fins lucrativos”, enquanto o atual CEO respondeu dizendo ter transformado algo “que estava morrendo” no que agora é avaliado em US$ 500 bilhões.

Desde então, a OpenAI se reestruturou como uma Public Benefit Corporation e se mantém no centro da corrida por inteligências artificiais cada vez mais poderosas.

Já Sutskever fundou a Safe Superintelligence, uma startup dedicada a desenvolver IA segura, avaliada em US$ 32 bilhões sem sequer ter receita.

No meio desse turbilhão, uma certeza permanece: o caminho da inteligência artificial continua sendo desenhado por decisões humanas, cheias de ambição, ideais e, acima de tudo, fragilidade.